AI恋愛相談は危険?依存や流出を防ぐリスク管理と賢い活用術

なぜ今、AIへの恋愛相談に「危険」を感じる人が多いのか

「誰にも言えないけど、AIになら話せる」——そう感じたことはありませんか?恋愛の悩みは、友人にも家族にも相談しにくいものです。だからこそ、AIという選択肢が急速に広まっています。しかし同時に、「AIへの相談って、本当に大丈夫?」という不安の声も増えています。このセクションでは、AIに恋愛相談をする心理的背景と、見落とされがちなリスクを整理します。

誰にも言えない悩みだからこそAIに頼ってしまう心理

24時間即レスという圧倒的な「受容感」の正体

AIが恋愛相談の場として選ばれる最大の理由のひとつが、「いつでも即座に答えてくれる」という点です。深夜2時に不安で眠れなくても、AIは返答してくれます。この即応性は、孤独感を和らげる効果があります。

ただし、注意が必要です。この「受容感」は、AIが本当に共感しているわけではありません。設計された応答パターンによるものです。人間関係における「受け止めてもらえた」という感覚とは、本質的に異なります。温かさを感じるほど、その違いに気づきにくくなる点を覚えておきましょう。

否定されない安心感がもたらす「依存」の入り口

AIは基本的に、ユーザーの話を真っ向から否定しません。「それはあなたが悪い」とはなかなか言わないのです。この特性は、傷ついた心には一時的な安らぎになります。

しかし、否定されない環境が続くと、「自分は正しい」という思い込みが強化されていくリスクがあります。現実の人間関係では、時に厳しいフィードバックが成長につながります。AIとの会話にそれを期待しすぎると、少しずつ現実とのギャップが広がっていく可能性があります。

「AIは完璧ではない」という前提を忘れるリスク

AIへの信頼感が高まるほど、ある重要な事実が薄れていきます。それは、AIが「間違えることがある」という現実です。

ハルシネーション(幻覚)とは、AIが事実ではない情報を自信満々に話す現象です。恋愛相談の文脈では、「こういうケースでは一般的に〜です」と断言した内容が、実際には根拠のない推測であることもあります。

また、AIは相手の表情・声のトーン・過去の関係性といった非言語情報を把握できません。あなたが言葉で伝えた情報だけをもとにアドバイスを生成するため、実際の状況とかけ離れた提案が出ることも珍しくありません。

さらに、AIの回答は学習データや設計方針によって、倫理的・文化的に偏りを持つことがあります。特定の価値観に基づいたアドバイスが、あなたの状況や相手の文化的背景に合わない可能性もある点を意識しておく必要があります。

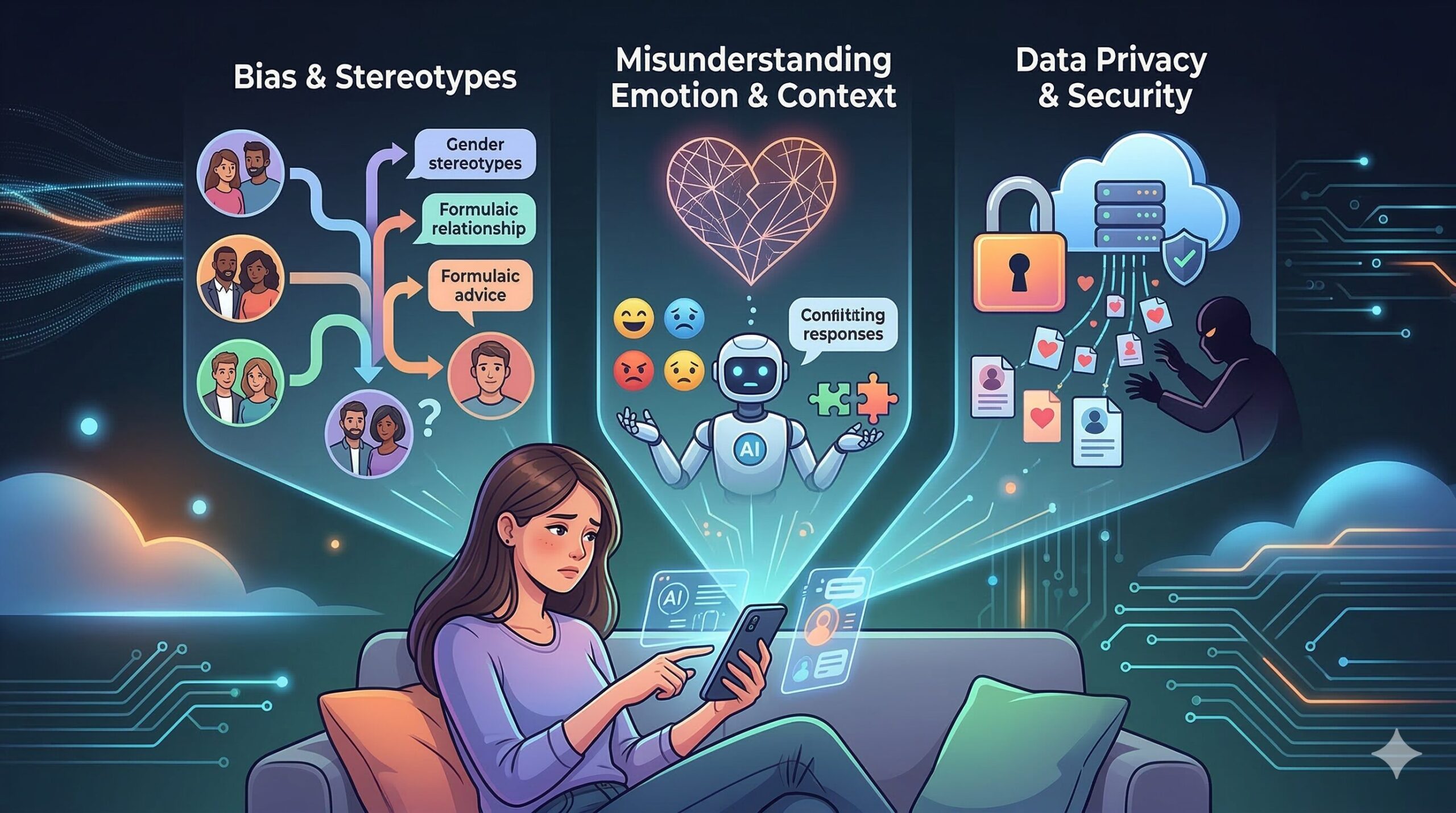

知っておくべきAI恋愛相談の「3つの具体的リスク」

AIへの恋愛相談には、心理的な問題だけでなく、より現実的なリスクも伴います。「知らなかった」では済まされない3つのポイントを具体的に解説します。あなたのプライバシーと心を守るために、ぜひ最後まで読んでください。

リスク①:個人情報の流出とデータ学習への利用

入力した「具体的なエピソード」がAIの学習データになる?

「昨日、彼に〇〇と言われて傷ついた」「職場の△△さんとの関係で悩んでいる」——こうした具体的なエピソードをAIに入力したとき、その情報はどこへ行くのでしょうか。

多くのAIサービスでは、入力されたデータがサービス改善や学習に利用される場合があります。設定によっては学習をオフにできるものもありますが、デフォルトでオンになっているケースも少なくありません。あなたの個人的な悩みが、将来のAIの回答パターン形成に使われる可能性を念頭に置いておきましょう。

特定の個人や企業名を出してはいけない理由

AIへの相談で「田中さん(仮名)という同僚が…」と入力した場合、その情報はシステム上に残ります。たとえ悪意がなくても、第三者の個人情報や企業に関わる情報を入力することは、プライバシー侵害につながるリスクがあります。

本人の同意なく他者の情報をAIに入力することは、トラブルの原因になりかねません。相談する際は、登場人物の情報を極力匿名化・抽象化することが重要です。

運営元のプライバシーポリシーを確認する癖をつけよう

AIサービスを利用する前に、プライバシーポリシーを確認することをおすすめします。確認すべき主なポイントは以下の通りです。

| 確認項目 | チェックのポイント |

|---|---|

| データの学習利用 | 入力内容がAIの学習に使用されるか |

| 保存期間と削除方法 | データはいつまで保持されるか、削除できるか |

| 第三者への提供 | 第三者にデータが渡る可能性があるか |

面倒に感じるかもしれませんが、この一手間が自分のプライバシーを守る第一歩になります。

リスク②:感情的な依存と「現実逃避」の加速

現実の相手よりもAIとの会話が楽しくなる「逆転現象」

AIとの会話は、現実の人間関係より「楽」です。否定されない、傷つけられない、いつでも話せる——これらの要素が重なると、現実の相手とのコミュニケーションが煩わしく感じられるようになることがあります。

この「逆転現象」は、恋愛関係において特に深刻です。パートナーへの不満をAIにぶつけ続けることで、関係改善に向けた行動をとる動機が薄れていく可能性があります。

自分の都合の良い回答だけを求める「エコーチェンバー」のリスク

エコーチェンバーとは、自分の意見や考えが反響し合い、増幅されていく閉鎖的な環境のことです。AIに「私は悪くないですよね?」と問いかければ、多くの場合、それに沿った方向の回答が返ってきます。

これが繰り返されると、自分の認知の歪みに気づく機会が失われます。現実の人間関係で必要な「相手の視点に立つ力」が育ちにくくなるリスクがあります。

AIに依存することで失われる「対人コミュニケーション能力」

コミュニケーション能力は、経験を積むことで磨かれるスキルです。困ったときにAIに頼る習慣が定着すると、以下の力が少しずつ鈍化していく可能性があります。

- 現実の場面で自分の言葉で伝える力

- 相手の感情を読む力

- 予測不能な反応に対応する力

これは長期的に見たとき、現実の人間関係の質に影響を与えかねない問題です。

リスク③:意思決定の放棄が招く後悔

「AIが言ったから」という理由で行動する危険性

「AIがそう言ったから別れを切り出した」「AIのアドバイス通りに告白したら失敗した」——こうした経験をした人は、少なからず存在します。

AIは状況を完全には把握できていません。あなたの相手の性格、ふたりの歴史、その日の空気感——こうしたリアルな文脈を持たないまま出された提案に、人生の重要な判断を委ねることには慎重であるべきです。

失敗したときに誰の責任にもできないという現実

AIのアドバイスに従って行動し、うまくいかなかった場合、誰かに責任を問うことはできません。AIはツールであり、行動を選択したのは自分自身だからです。

「AIに言われたから」という思考は、自分の判断力を外部に預けてしまっているサインでもあります。後悔が生じたときに、この「責任の所在」の問題は大きく響きます。

最終的な判断をAIに委ねてはいけない本当の理由

AIはあなたの人生を生きていません。あなたの価値観、大切にしているもの、将来の夢——それらを本当に理解したうえでアドバイスできるのは、最終的には自分自身だけです。

AIはあくまで「考えるための素材」を提供するツールです。判断そのものは、自分が主体となって行うことが不可欠です。

リスクを最小限に!AI恋愛相談を「安全なツール」にする方法

リスクを知ったうえで「それでも活用したい」と思う方へ。正しく使えば、AIは心強い思考の道具になります。ここでは、AIを安全に・賢く使うための具体的な方法をお伝えします。

匿名性を徹底する「プロンプト」の書き方

人名、場所、会社名を伏せる具体的なテンプレート

相談するときは、以下のように書き換える習慣をつけましょう。

| 変換前(NG例) | 変換後(OK例) |

|---|---|

| 田中さん(30代・同じ職場の先輩)に告白しようか迷っています | 職場の年上の人に好意を持っています。告白のタイミングについてアドバイスをください |

| ○○株式会社の同僚との関係で悩んでいます | 同じ部署の同僚との関係で悩んでいます |

固有名詞を取り除くだけで、個人情報の流出リスクを大きく減らせます。

相談内容を抽象化して「一般論」として聞くコツ

「私のケースでは…」と個別具体的に話すのではなく、次のような問い方に変えましょう。

- 変更前:「私の場合、どうすればいいですか?」

- 変更後:「こういう状況の場合、一般的にはどう考えるのが適切でしょうか?」

AIは一般論を扱うことが得意です。その強みを活かす使い方がおすすめです。

重要な情報は入力せず「壁打ち」として活用する

AIへの相談を、「答えをもらう場」ではなく「自分の考えを整理する場」と捉え直しましょう。「こんな状況で自分はどう感じているんだろう?」を言語化する手助けとして使うのが、最も安全で実りある活用法です。

AIの回答を「セカンドオピニオン」として扱う

1つの回答を信じず、複数のAIや人間と比較する

医療の世界では、ひとりの医師の診断だけで判断せず、別の専門家にも意見を求める「セカンドオピニオン」が一般的です。AIへの恋愛相談も、同じ考え方が使えます。

- ひとつのAIの回答を絶対視しない

- 別のAIでも試してみる

- 信頼できる友人にも話してみる

複数の視点を比べることで、より立体的な判断ができるようになります。

AIの提案を「自分の頭で考えるためのヒント」に変える

AIの回答を読んだあと、「これは自分の状況に本当に当てはまる?」と一度立ち止まって考える習慣を持ちましょう。回答をそのまま行動指針にするのではなく、「考えるきっかけ」として捉えることが、依存を防ぐ鍵になります。

専門家(カウンセラー)とAIの使い分け基準

次のような場合は、AIではなく専門家への相談を優先しましょう。

| 状況 | 相談先 |

|---|---|

| 気軽に考えを整理したい | AI |

| 気持ちが長期間落ち込んでいる | カウンセラー・専門家 |

| 相手との関係で心身に影響が出ている | カウンセラー・専門家 |

| 自分でも判断がつかず混乱が続いている | カウンセラー・専門家 |

AIは気軽に使えるのが強みですが、深刻な状況にはプロのサポートが必要です。この使い分けを意識するだけで、AIとの付き合い方が格段に健全になります。

使用時間と目的を制限するセルフ管理

「1日30分まで」など、依存を防ぐためのルール作り

AIとの会話は、気づけば長時間になりがちです。次のようなルールを設けると、依存を防ぎやすくなります。

- 1日の使用時間に上限を決める(例:30分まで)

- 「この件について考えたら一度スマホを置く」と決める

- スクリーンタイム機能やタイマーを活用する

シンプルなルールほど、継続しやすくなります。

自分の感情が不安定なときは、一度スマホを置く勇気

感情が揺れているときほど、AIに頼りたくなるものです。しかし、不安定な状態のときに入力した情報は、必要以上に個人的な内容になりやすい傾向があります。誘導的な回答に影響されやすくもなります。

「今の自分はAIに頼れる状態か?」と自問する習慣が、長い目で見てプライバシーと心を守ることにつながります。

まとめ:AIは恋愛の「伴走者」であって「主役」ではない

AI恋愛相談の危険性は、正しく知ればコントロール可能です。闇雲に怖がる必要はありませんが、「なんとなく便利だから」と無防備に使うのも避けるべきでしょう。

AIの仕組みを理解し、限界を知り、賢く使いこなすAIリテラシーが、今の時代には不可欠です。

:::note

今日からできること:3つのアクション

- プライバシーを守る:相談するときは固有名詞(人名・会社名・地名)を外す

- 回答を客観視する:AIの回答を「ひとつの意見」として受け取り、鵜呑みにしない

- 時間を管理する:1日の使用時間に上限を設け、感情が不安定なときは使わない

- 専門家と使い分ける:深刻な悩みはカウンセラーなどプロに相談する

- 主役は自分:最終的な判断は、常に自分自身が行う

:::

AIはあなたの恋愛を代わりに生きてくれるわけではありません。しかし、正しく活用すれば、自分の気持ちを整理し、次の一歩を踏み出すための心強いサポーターになってくれます。大切なのは、主役はいつも「あなた自身」だということを忘れないことです。